Hvad er Bayes sætning?

Bayes 'sætning er en opskrift, der viser, hvordan man kan opdatere sandsynligheden for teorier, når den får bevis. Det forfølger grundlæggende fra maksimerne af betinget sandsynlighed, men det kan bruges til at kunne resonnere et bredt omfang af problemer, herunder overbevisning opdateres.

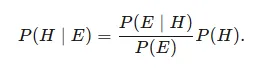

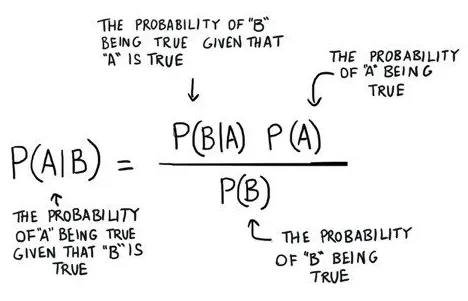

Givet en teori H og bevis E, udtrykker Bayes teorem, at forbindelsen mellem sandsynligheden for spekulationen inden man får beviset P (H) og sandsynligheden for teorien i kølvandet på at få beviset P (H∣E) er

Det er et smukt begreb sandsynlighed, hvor vi finder sandsynligheden, når vi kender anden sandsynlighed

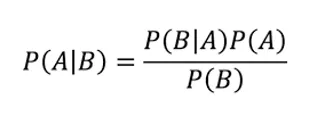

Hvilket fortæller os: hvor regelmæssigt A sker, i betragtning af at B forekommer, sammensat af P (A | B),

Når vi ved: hvor regelmæssigt B sker, da A forekommer, sammensat P (B | A)

derudover, hvor sandsynligt, at An er uden nogen anden, komponeret P (A)

hvad mere er, hvor sandsynligt B er uden nogen anden, sammensat P (B)

Eksempel på Bayes sætning

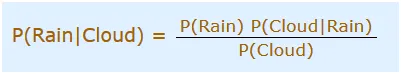

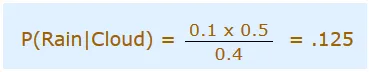

Du arrangerer en udflugt i dag, men morgenen er overskyet, Gud hjælper os! halvdelen af hver eneste stormfulde dag starter skyggefuldt! Under alle omstændigheder er skyggefulde morgener normale (ca. 40% af dage starter overskyet) Desuden er dette generelt en tør måned (kun 3 af 30 dage vil generelt være stormfulde eller 10%). Hvad er sandsynligheden for nedbør i løbet af dagen? Vi vil bruge regn til at betyde regn i løbet af dagen, og sky til at betyde overskyet morgen. Muligheden for Rain given Cloud er sammensat af P (Rain | Cloud)

Så vi bør placere det i ligningen:

- P (regn) Sandsynlighed for, at det vil være regn = 10% (givet)

- P (Sky | regn) Sandsynlighed for, at skyer er der, og regn sker = 50%

- P (Cloud) er sandsynligheden for, at skyer er der = 40%

Så vi kan sige, at i c:

Det er Bayes sætning: at du kan udnytte sandsynligheden for en ting for at forudse sandsynligheden for noget andet. Alligevel er Bayes sætning alt andet end en statisk ting. Det er en maskine, som du skruer fast for at forbedre og bedre prognoser som nye bevisoverflader. En spændende aktivitet er at knytte faktorerne til ved at henvise til karakteristiske teoretiske kvaliteter til P (B) eller P (A) og overveje deres sammenhængende virkning på P (A | B). I tilfælde af at du øger nævneren P (B) til højre, går P (A | B) for eksempel ned. Fast model: En løbende næse er en indikation af mæslingerne, men alligevel er løbende næser unægtelig mere typiske end hududslæt med små hvide pletter. Det vil sige, i tilfælde af at du vælger P (B), hvor B er en løbende næse, på det tidspunkt afviser tilbagevenden af løbende næser i den samlede offentlighed muligheden for, at en løbende næse er en indikation af mæslinger. Sandsynligheden for en fundelse af mæslinger falder med hensyn til bivirkninger, der gradvis bliver normale; disse manifestationer er ikke solide pointer. På samme måde, når mæslinger bliver mere og mere normale og P (A) går op i tælleren til højre, går P (A | B) væsentligt op med den begrundelse, at mæslingerne simpelthen ofte er mere sandsynlige, idet der ikke er meget opmærksom på bivirkningen, som du overvejer.

Brug af Bayes sætning i maskinlæring

Naive Bayes Classifier

Naive Bayes er en karakteriseringsberegning for dobbelt (to-klasse) og multi-class gruppering problemer. Systemet er mindst krævende at forstå, når det afbildes ved hjælp af dobbelt eller lige ud informationskvaliteter.

Det kaldes naive Bayes eller imbecile Bayes i lyset af det faktum, at beregningen af sandsynlighederne for hver teori er strømlinet for at gøre deres tæller kan bæres. I modsætning til at forsøge at fastslå estimeringerne for hver egenskabsværdighed P (d1, d2, d3 | h), anses de for at være restriktivt frie i betragtning af objektivets værdi og bestemt som P (d1 | h) * P (d2 | H, etc.

Dette er en solid antagelse, der er mest langsigtet i ægte oplysninger, for eksempel om, at egenskaberne ikke kommunikerer. Af og til klarer metodikken chokerende godt information, hvor denne formodning ikke indeholder.

Skildring brugt af Naive Bayes modeller

Skildringen af en naiv Bayes-algoritme er sandsynligheden.

Sæt med sandsynligheder udsættes for at andrage en videnskabelig naiv bayesisk model. Dette inkluderer:

Klassesandsynlighed: Sandsynligheden for alt i forberedelsesdatasættet.

Betinget sandsynlighed: Den betingede sandsynlighed for hver forekomst info værd givet hver klassevurdering.

Tag en Naive Bayes-model ud fra data. Det er hurtigt at indtage en naiv bayesisk model fra forberedelsesoplysninger. Forberedelsen er hurtig i lyset af det faktum, at ens sandsynlighedsværdierne for hver forekomst af klassen og sandsynlighedsværdien for hvert forekomst af klassen, der gives særskilte informationsværdier (x), skal bestemmes. Ingen koefficienter bør være tilpasset af forbedringssystemer.

Beregning af klassesandsynligheder

En klassesandsynlighed er dybest set gentagelsen af sager, der har et sted med hver klasse isoleret af det komplette antal sager.

I en parallel klasse bestemmes for eksempel sandsynligheden for, at en sag har et sted med klasse 1:

Sandsynlighed (klasse = 1) = total (klasse = 1) / (total (klasse = 0) + total (klasse = 1))

I det mest enkle tilfælde har hver klasse en sandsynlighed på 0, 5 eller halvt for et todelt klassificeringsproblem med et lignende antal forekomster i hvert tilfælde af klassen.

Beregning af betinget sandsynlighed

De betingede sandsynligheder er tilbagevenden af hver egenskabskvalitet for en given klasse værd, der er delt op ved gentagelsen af eksempler med den klasseskøn.

Alle anvendelser af Bayes 'sætning

Der er mange anvendelser af Bayes 'sætning i virkeligheden. Forsøg ikke at stresse med off-chancen for, at du ikke ser al den aritmetik, der medfølger med det samme. Det er bare tilstrækkeligt at begynde at få en fornemmelse af, hvordan den fungerer.

Bayesian Decision Theory er en målbar måde at håndtere spørgsmålet om klassificering af eksempler på. Under denne hypotese forventes det, at den grundlæggende sandsynlighedstransport for klasserne er kendt. På denne måde erhverver vi en perfekt Bayes Classifier, som enhver anden klassifikator træffes for en beslutning om udførelse.

Vi vil tale om de tre grundlæggende anvendelser af Bayes 'sætning:

- Naive Bayes 'klassifikator

- Diskriminerende funktioner og beslutningsoverflader

- Bayesiansk parameterestimering

Konklusion

Storslåethed og intensitet af Bayes 'sætning stopper aldrig for mig. En grundlæggende idé, givet af en præst, der gik videre for over 250 år tilbage, har dens anvendelse i de absolut mest umiskendelige AI-procedurer i dag.

Anbefalede artikler

Dette er en guide til Bayes sætning. Her diskuterer vi brugen af Bayes teorem i maskinlæring og skildringen brugt af Naive Bayes modeller med eksempler. Du kan også se på de følgende artikler for at lære mere -

- Naive Bayes algoritme

- Typer af maskinlæringsalgoritmer

- Maskinlæringsmodeller

- Metoder til maskinindlæring