Forskel mellem neurale netværk og dyb læring

Med den enorme overgang i dagens teknologi kræver det mere end bare Big Data og Hadoop at transformere virksomheder. Virksomhederne i dag bevæger sig mod AI og integrerer maskinlæring som deres nye teknik. Neurale netværk eller konnektionistiske systemer er de systemer, der er inspireret af vores biologiske neurale netværk. Disse typer systemer trænes til at lære og tilpasse sig efter behov. For eksempel i tilfælde af billedgenkendelse, når de først er identificeret med katte, kan de let bruge det resultatsæt til at adskille billeder med katte med dem uden katte. Mens de gør dette har de ikke nogen forudgående viden om kattens egenskaber, men de udvikler deres eget sæt unikke funktioner, som er nyttige i deres identifikation. Et andet begreb, der er tæt forbundet med dette, er dyb læring, også kendt som hierarkisk læring. Dette er baseret på læringsdata-repræsentationer, der er modsatte af opgavebaserede algoritmer. Det kan yderligere kategoriseres i overvågede, semi-overvågede og uovervågede læringsteknikker. Der er adskillige arkitekturer forbundet med dyb læring såsom dybe neurale netværk, trosnetværk og tilbagevendende netværk, hvis anvendelse ligger i naturlig sprogbehandling, computervision, talegenkendelse, filtrering af socialt netværk, lydgenkendelse, bioinformatik, maskinoversættelse, stofdesign og listen fortsætter og fortsætter. Lad os diskutere neurale netværk og dyb læring i detaljer i vores indlæg.

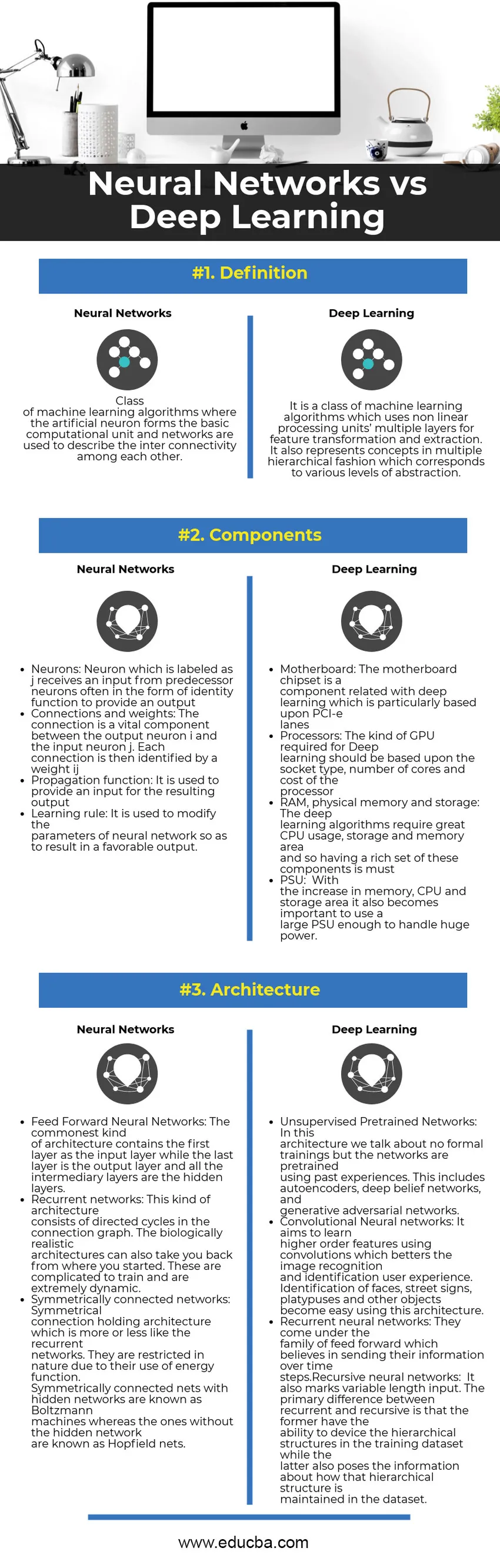

Head to Head-sammenligning mellem neurale netværk vs dyb læring (Infographics)

Vigtigste forskelle mellem neurale netværk kontra dyb læring:

Forskellene mellem neurale netværk og dyb læring er forklaret i nedenstående punkter:

- Neurale netværk bruger neuroner, der bruges til at transmittere data i form af inputværdier og outputværdier. De bruges til at overføre data ved hjælp af netværk eller forbindelser. Dyb læring er på den anden side relateret til transformation og ekstraktion af funktion, der forsøger at etablere en forbindelse mellem stimuli og tilhørende neurale responser, der findes i hjernen.

- Anvendelsesområder til neuralt netværk inkluderer systemidentifikation, styring af naturressourcer, processtyring, køretøjskontrol, kvantekemi, beslutningstagning, spil, ansigtsidentifikation, mønstergenkendelse, signalklassificering, sekvensgenkendelse, genkendelse af objekt, finans, medicinsk diagnose, visualisering, data mining, maskinoversættelse, e-mail spamfiltrering, socialt netværksfiltrering osv. hvorimod anvendelse af dyb læring inkluderer automatisk talegenkendelse, billedgenkendelse, visuel kunstbehandling, behandling af naturligt sprog, opdagelse af stof og toksikologi, styring af kundeforhold, anbefalingsmotorer, mobil reklame, bioinformatik, billedrestaurering osv.

- Kritik, der støder på for neurale netværk, inkluderer sådanne som træningsproblemer, teoretiske spørgsmål, hardwareproblemer, praktiske modeksempler på kritik, hybrid tilgange, mens det for dyb læring er relateret til teori, fejl, cybertrussel osv.

Neurale netværk vs dyb lærings sammenligningstabel

| Grundlag for sammenligning | Neurale netværk | Dyb læring |

| Definition | Klasse af maskinlæringsalgoritmer, hvor den kunstige neuron udgør den grundlæggende beregningsenhed og netværk bruges til at beskrive sammenkoblingen mellem hinanden | Det er en klasse af maskinlæringsalgoritmer, der bruger ikke-lineære behandlingsenheders flere lag til funktionstransformation og ekstraktion. Det repræsenterer også koncepter i flere hierarkiske mode, der svarer til forskellige niveauer af abstraktion. |

| komponenter | Neuroner: Neuron, der er mærket som j, modtager et input fra forgængerneuroner ofte i form af identitetsfunktion for at give et output. Forbindelser og vægte: Forbindelsen er en vigtig komponent mellem outputneuronet i og inputneuronet j. Hver forbindelse identificeres derefter med en vægt ij. Formeringsfunktion: Den bruges til at give et input til den resulterende output. Læringsregel: Det bruges til at ændre parametre for neuralt netværk for at resultere i en gunstig output. | Bundkort: Bundkortets chipset er en komponent relateret til dyb læring, som især er baseret på PCI-e-baner. Processorer : Den type GPU, der kræves til dyb læring, skal være baseret på sokkeltypen, antallet af kerner og omkostningerne for processoren. RAM, fysisk hukommelse og opbevaring: De dybe indlæringsalgoritmer kræver stor CPU-brug, opbevaring og hukommelsesområde, og det er derfor et must at have et rigt sæt af disse komponenter. PSU: Med stigningen i hukommelse, CPU og lagerområde bliver det også vigtigt at bruge en stor PSU nok til at håndtere enorm strøm. |

| Arkitektur | Feed fremad neurale netværk: Den mest almindelige arkitekturtype indeholder det første lag som inputlag, mens det sidste lag er outputlaget, og alle mellemlagene er de skjulte lag. Tilbagevendende netværk: Denne type arkitektur består af styrede cyklusser i forbindelsesgrafen. De biologisk realistiske arkitekturer kan også føre dig tilbage fra det sted, du startede. Disse er komplicerede at træne og er ekstremt dynamiske. Symmetrisk tilsluttede netværk: Symmetrisk forbindelse med arkitektur, der mere eller mindre ligner de tilbagevendende netværk. De er begrænset i naturen på grund af deres brug af energifunktion. Symmetrisk forbundne net med skjulte netværk kaldes Boltzmann-maskiner, mens dem uden det skjulte netværk er kendt som Hopfield-net. | Ikke-overvågede foruddannede netværk: I denne arkitektur taler vi om ingen formel træning, men netværkene er foruddannet ved hjælp af tidligere oplevelser. Dette inkluderer autoencodere, deep faith-netværk og generative modstandernetværk. Konvolutional neurale netværk: Det sigter mod at lære funktioner med højere orden ved hjælp af vindinger, der better billedgenkendelsen og identifikation brugeroplevelsen. Identifikation af ansigter, gateskilt, platypuses og andre objekter bliver let ved hjælp af denne arkitektur. Tilbagevendende neurale netværk: De kommer fra familien af fremadrettet, som tror på at sende deres information over tid. Rekursive neurale netværk: Det markerer også input med variabel længde. Den primære forskel mellem tilbagevendende og rekursiv er, at førstnævnte har evnen til at en anordning de hierarkiske strukturer i træningsdatasættet, mens sidstnævnte også indeholder informationen om, hvordan den hierarkiske struktur opretholdes i datasættet. |

Konklusion - Neurale netværk kontra dyb læring

AI er et ekstremt magtfuldt og interessant felt, der kun vil blive mere allestedsnærværende og vigtigt at komme videre og sikkert vil have enorme virkninger på samfundet som helhed. Disse to teknikker er nogle af AIs meget kraftfulde værktøjer til at løse komplekse problemer og vil fortsat udvikle og vokse i fremtiden for at vi kan udnytte dem.

Anbefalet artikel

Dette har været en guide til neurale netværk kontra dyb læring, deres betydning, sammenligning mellem hoved og hoved, nøgleforskelle, sammenligningstabel og konklusion. Du kan også se på de følgende artikler for at lære mere -

- Bedste 7 forskel mellem Data Mining Vs Data Analyse

- Machine Learning vs Predictive Analytics - 7 nyttige forskelle

- Data Mining Vs Data Visualization - Hvilken der er bedre

- Business Intelligence vs BigData - 6 fantastiske sammenligninger