Forskellen mellem regression vs klassificering

I denne artikel Regression vs klassificering, lad os diskutere de vigtigste forskelle mellem regression og klassificering. Maskinindlæring er stort set opdelt i to typer, de er Overvåget maskinindlæring og Uovervåget maskinlæring. I overvåget maskinlæring har vi en kendt outputværdi i datasæt, og vi træner modellen baseret på disse og bruger den til forudsigelse, mens vi i ikke-overvåget maskinlæring ikke har et kendt sæt outputværdier. På forhånd for at skelne mellem klassificering og regression, lad os forstå, hvad betyder denne terminologi i maskinlæring. Regression er en algoritme i overvåget maskinlæring, der kan trænes til at forudsige output af reelle tal. Klassificering er en algoritme i overvåget maskinlæring, der trænes til at identificere kategorier og forudsige i hvilken kategori de falder for nye værdier.

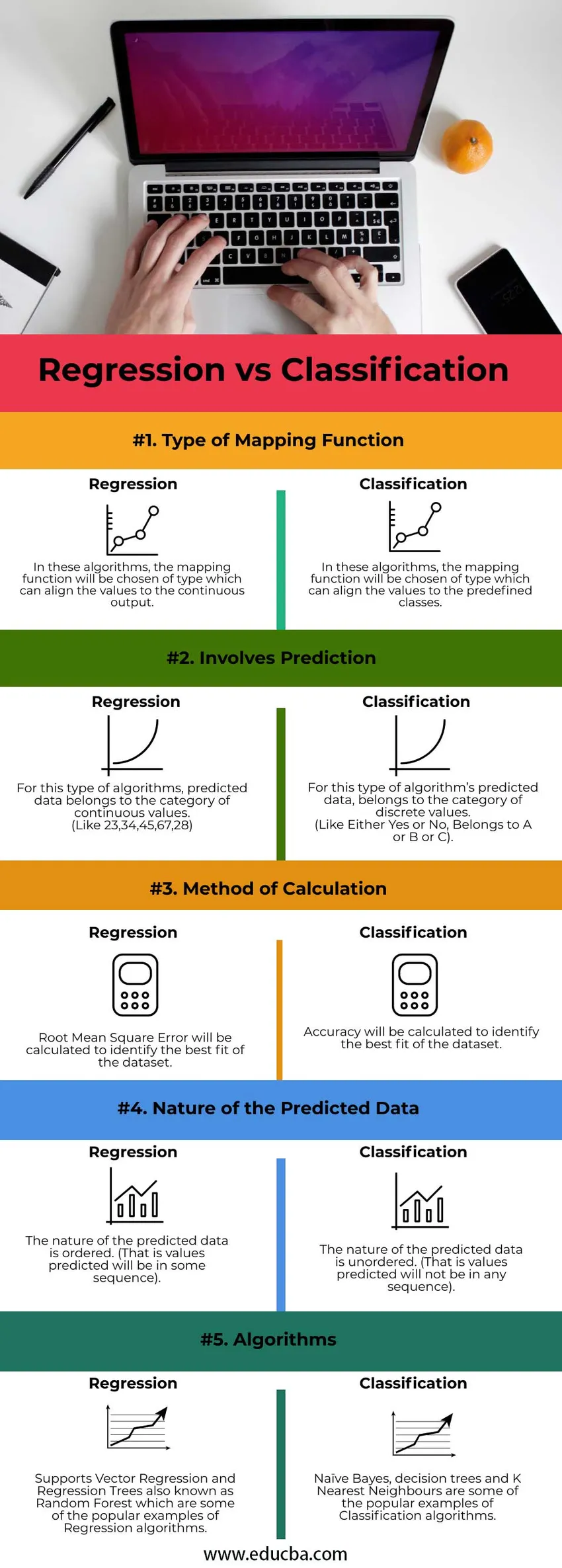

Sammenligning fra hoved til hoved mellem regression vs klassificering (infografik)

Nedenfor er Top 5-sammenligningen mellem regression vs klassificering :

De vigtigste forskelle mellem regression vs klassificering

Lad os diskutere nogle af de vigtigste forskelle mellem Regression vs Klassificering på følgende punkter:

- Klassificering handler om at forudsige en etiket eller kategori. Klassificeringsalgoritme klassificerer det krævede datasæt i en af to eller flere etiketter, en algoritme, der beskæftiger sig med to klasser eller kategorier, er kendt som en binær klassifikator, og hvis der er mere end to klasser, kan den kaldes som multiklasse klassificeringsalgoritme.

- Regression handler om at finde en optimal funktion til at identificere data om kontinuerlige reelle værdier og foretage forudsigelser af denne mængde. Regression med flere variabler som input eller funktioner til at træne algoritmen er kendt som et multivariat regressionsproblem. Hvis inputværdierne i regressionsproblemet er afhængige eller ordnet efter tid, kaldes det tidsserieprognoseproblem.

- Klassificeringsmodellen vil imidlertid også forudsige en kontinuerlig værdi, som er sandsynligheden for, at hændelsen hører til den respektive outputklasse. Her repræsenterer sandsynligheden for begivenhed sandsynligheden for, at et givet eksempel hører til en bestemt klasse. Den forudsagte sandsynlighedsværdi kan konverteres til en klasseværdi ved at vælge den klassemærke, der har den højeste sandsynlighed.

- Lad os forstå dette bedre ved at se et eksempel, antage, at vi træner modellen til at forudsige, om en person har kræft eller ikke er baseret på nogle funktioner. Hvis vi får sandsynligheden for, at en person har kræft som 0, 8 og ikke har kræft som 0, 2, kan vi konvertere 0, 8-sandsynligheden til et klassemærke, der har kræft, da det har den højeste sandsynlighed.

- Som nævnt ovenfor i klassificeringen for at se, hvor god klassificeringsmodel fungerer, beregner vi nøjagtighed. Lad os se, hvordan beregningen udføres, nøjagtighed i klassificering kan udføres ved at tage forholdet mellem korrekte forudsigelser og samlede forudsigelser ganget med 100. Hvis der er foretaget 50 forudsigelser og 10 af dem er korrekte og 40 er forkerte, vil nøjagtigheden være 20 %.

Nøjagtighed = (Antal korrekte forudsigelser / Samlet antal forudsigelser) * (100)

- Nøjagtighed = (10/50) * (100)

- Nøjagtighed = 20%

- Som nævnt ovenfor i regression er det at beregne, hvor god regressionsmodellen udfører den mest populære måde, at beregne root mean square error (RMSE). Lad os se, hvordan beregningen udføres.

Den forudsagte værdi af regressionsmodellen er 4, 9, mens den faktiske værdi er 5, 3.

Den forudsagte værdi af regressionsmodellen er 2, 3, mens den faktiske værdi er 2, 1.

Den forudsagte værdi af regressionsmodellen er 3, 4, mens den aktuelle værdi er 2, 9.

Root betyder, at kvadratisk fejl kan beregnes ved hjælp af formlen.

Kvadratisk fejl er (5, 3-4, 9) 2 = 0, 16, (2, 1-2, 3) 2 = 0, 04, (2, 9-3, 4) 2 = 0, 25

Gennemsnit af fejlen i kvadrat = 0, 45 / 3 = 0, 15

Root gennemsnit kvadratisk fejl = kvadrat rod på 0, 15 = 0, 38

Det er RMSE = 0, 38. Der er mange andre metoder til at beregne effektiviteten af modellen, men RMSE er den mest anvendte, fordi RMSE tilbyder fejlresultatet i de samme enheder som den forudsagte værdi.

Eksempler:

De fleste data-videnskabsingeniører har svært ved at vælge en mellem regression og klassificering i begyndelsesfasen af deres karriere. For at gøre det let, lad os se, hvordan klassificeringsproblemerne ser ud, og hvordan regressionsproblemerne ser ud,

Klassifikation

- Forudsiger om det regner eller ej i morgen.

- At forudsige en person skal købe det gode eller ikke for at tjene penge.

- At forudsige, om en person har en sygdom eller ej.

Hvis du bemærker for hver situation her, kan der enten være et Ja eller Nej som en output-forudsagt værdi.

Regression

- Forudsigelse af prisen på jord.

- Forudsigelse af lagerprisen.

Hvis du bemærker for hver situation her har de fleste af dem en numerisk værdi som forudsagt output.

Sammenligningstabel over regression vs klassificering

Tabellen nedenfor opsummerer sammenligningerne mellem Regression vs Klassificering :

| Parameter | Regression |

Klassifikation |

| Type af kortlægningsfunktion | I disse algoritmer vælges kortlægningsfunktionen af typen, der kan justere værdierne til den kontinuerlige output. | I disse algoritmer vælges kortlægningsfunktionen af typen, der kan justere værdierne til de foruddefinerede klasser. |

| Indbefatter forudsigelse | For denne type algoritmer hører forudsagte data til kategorien af kontinuerlige værdier.

(Synes godt om 23, 34, 45, 67, 28) | Til denne type algoritmes forudsagte data hører til kategorien af diskrete værdier.

(Ligesom enten ja eller nej, hører til A eller B eller C). |

| Beregningsmetode | Root Mean Square-fejl beregnes for at identificere datasætets bedste pasform. | Nøjagtighed beregnes for at identificere datasætets bedste pasform. |

| Arten af de forudsagte data | Arten af de forudsagte data ordnes. (Det er værdier, der er forudsagt, vil være i en række sekvens) | Arten af de forudsagte data er ikke sorteret. (Det er de forudsagte værdier vil ikke være i nogen rækkefølge). |

| Algoritmer | Understøtter vektorregression og regressionstræer er også kendt som Random Forest, som er nogle af de populære eksempler på regressionsalgoritmer. | Naive Bayes, beslutningstræer og K Nærmeste naboer er nogle af de populære eksempler på klassificeringsalgoritmer. |

Konklusion

Dette er nogle af de vigtigste forskelle mellem klassificering og regression. I nogle tilfælde kan de kontinuerlige outputværdier, der er forudsagt i regression, grupperes i etiketter og ændres til klassificeringsmodeller. Så vi er nødt til at forstå klart, hvilken man skal vælge, baseret på situationen, og hvad vi ønsker, at det forudsagte output skal være.

Anbefalede artikler

Dette er en guide til den største forskel mellem Regression vs Klassificering. Her diskuterer vi også forskellene mellem regression og klassificering med infografik og sammenligningstabel. Du kan også se på de følgende artikler for at lære mere -

- Top 7 typer af chiffer

- Hvad er StringBuilder i C # med fordele

- StringBuffer vs StringBuilder | Top 4 sammenligning

- Topforskelle - Jira vs Github

- Hvad er regressionsanalyse?

- Multivariat regression

- Klassificeringsalgoritmer

- Opret beslutningstræ med fordele