Introduktion til enkel lineær regression

Fra ordbog : En tilbagevenden til en tidligere eller mindre udviklet tilstand.

I statistik: Et mål for forholdet mellem middelværdien af en variabel og tilsvarende værdier for de andre variabler.

Regressionen, hvor forholdet mellem inputvariablen (uafhængig variabel) og målvariablen (afhængig variabel) betragtes som lineær kaldes Lineær regression. Simpel lineær regression er en type lineær regression, hvor vi kun har en uafhængig variabel til at forudsige den afhængige variabel. Simpel lineær regression er en af maskinlæringsalgoritmerne. Enkel lineær regression hører til familien med Supervised Learning. Regression bruges til at forudsige kontinuerlige værdier.

Model af enkel lineær regression

Lad os gøre det enkelt. Hvordan det hele startede?

Det hele startede i 1800 med Francis Galton. Han studerede forholdet i højden mellem fædre og deres sønner. Han observerede et mønster: Enten ville sønns højde være lige så høj som hans fars højde eller sønns højde vil have en tendens til at være tættere på den samlede gennemsnitlige højde for alle mennesker. Dette fænomen er intet andet end regression.

For eksempel er Shaq O'Neal en meget berømt NBA-spiller og er 2, 16 meter høj. Hans sønner Shaqir og Shareef O'neal er henholdsvis 1, 96 meter og 2, 06 meter høje. Den gennemsnitlige befolkningshøjde er 1, 76 meter. Sønns højde regresserer (driver mod) gennemsnitshøjden.

Hvordan gør vi regression?

Beregning af en regression med kun to datapunkter:

Alt hvad vi vil gøre for at finde den bedste regression er at tegne en linje, der er så tæt på hver prik som muligt. I tilfælde af to datapunkter er det let at tegne en linje, bare slutte sig til dem.

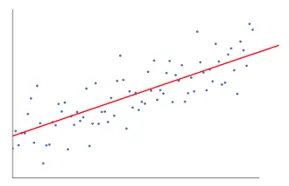

Hvis vi nu har et antal datapunkter, hvordan tegnes den linje, der er så tæt som muligt på hvert enkelt datapunkt.

I dette tilfælde er vores mål at minimere den lodrette afstand mellem linjen og alle datapunkter. På denne måde forudsiger vi den bedste linje for vores lineære regressionsmodel.

Hvad Simple Lineær Regression gør er?

Nedenfor er detaljerede forklaringer på Simple Linear Regression:

- Det tegner en masse mulige linjer og foretager derefter en af disse analyser.

- Summen af firkantede fejl.

- Summen af absolutte fejl.

- mindst kvadratmetode… osv

- Til vores analyse bruger vi den mindst kvadratiske metode.

- Vi vil gøre en forskel mellem alle point og beregne kvadratet af summen af alle punkter. Uanset hvilken linje der giver mindstebeløbet vil være vores bedste linje.

For eksempel: Ved at gøre dette kunne vi tage flere mænd og deres sønns højde og gøre ting som at fortælle en mand, hvor høj hans søn kunne være. før han endda blev født.

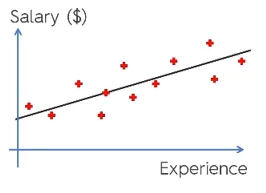

Google-billede

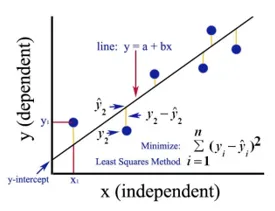

Ovenstående figur viser en enkel lineær regression. Linjen repræsenterer regressionslinjen. Givet af: y = a + b * x

Hvor y er den afhængige variabel (DV): For f.eks. Hvordan en persons løn ændres afhængigt af antallet af års erfaring, som medarbejderen har. Så her vil lønnen for en medarbejder eller person være din afhængige variabel.

Den afhængige variabel er vores målvariabel, den vi ønsker at forudsige ved hjælp af lineær regression.

x er vores uafhængige variabel (IV): Den afhængige variabel er årsagen til den uafhængige ændringsvariabel. I ovenstående eksempel er antallet af års erfaring vores afhængige variabel, fordi antallet af års erfaring medfører ændring i lønningen for medarbejderen.

- b er koefficientvariablen for vores uafhængige variabel x. Denne koefficient spiller en afgørende rolle. Den siger, hvordan en enhedsændring i x (IV) vil påvirke y (DV). Det benævnes også proportionalkoefficienten. Når det gælder matematik, er det op til dig, det er linjen hældning, eller du kan sige stejle af linjen.

- I vores eksempel, hvis hældningen (b) er mindre, hvilket betyder, at antallet af år vil give mindre løntilvækst på den anden side, hvis hældningen (b) er mere, vil give en høj lønforøgelse med en stigning i antallet af års erfaring.

- a er en konstant værdi. Det benævnes også afskærmning, det er her linjen skærer y-aksen eller DV-aksen. På en anden måde kan vi sige, at når en medarbejder har nul års erfaring (x), vil lønnen (y) for den ansatte være konstant (a).

Hvordan fungerer Mindstepladsen?

Nedenfor er punkterne for mindst kvadratisk arbejde:

- Det tegner en vilkårlig linje i henhold til datatendenser.

- Det tager datapunkter og tegner lodrette linjer. Den betragter lodret afstand som en parameter.

- Disse lodrette linier skærer regressionslinjen og giver det tilsvarende punkt for datapunkter.

- Derefter finder den den lodrette forskel mellem hvert datapunkt og dets tilsvarende datapunkt på regressionslinjen.

- Det beregner den fejl, der er firkantet af forskellen.

- Derefter beregnes summen af fejl.

- Derefter vil det igen tegne en linje og gentage ovenstående procedure igen.

- Det tegner et antal linjer på denne måde, og den linje, der giver mindst mulig fejl, vælges som den bedste linje.

- Denne bedste linje er vores enkle lineære regressionslinje.

Anvendelse af enkel lineær regression

Regressionsanalyse udføres for at forudsige den kontinuerlige variabel. Regressionsanalysen har en lang række applikationer. Nogle eksempler er som følger:

- Predictive Analytics

- Effektivitet af markedsføring,

- prisfastsættelse af enhver fortegnelse

- forudsigelse af forfremmelse for et produkt.

Her skal vi diskutere en anvendelse af lineær regression til forudsigelig analyse. Vi gør modellering ved hjælp af python.

De trin, vi skal følge for at opbygge vores model, er som følger:

- Vi importerer biblioteker og datasæt.

- Vi forarbejder dataene.

- Vi deler dataene i testsættet og træningssættet.

- Vi opretter en model, der prøver at forudsige målvariablen baseret på vores træningssæt

- Vi vil forudsige målvariablen for testsættet.

- Vi analyserer de resultater, der er forudsagt af modellen

Til vores analyse vil vi bruge et lønnsæt med data fra 30 ansatte.

# Import af biblioteker

import numpy as np

import matplotlib.pyplot as plt

import pandas as pd

# Import af datasættet (stikprøve af data vises i tabellen)

dataset = pd.read_csv('Salary_Data.csv')

| års erfaring | Løn |

| 1.5 | 37.731 |

| 1.1 | 39343 |

| 2.2 | 39891 |

| 2 | 43.525 |

| 1.3 | 46205 |

| 3.2 | 54.445 |

| 4 | 55.749 |

# Forbehandling af datasættet, her vil vi dele datasættet i den afhængige variabel og den uafhængige variabel. x som uafhængig og y som afhængig eller målvariabel

X = dataset.iloc(:, :-1).values

y = dataset.iloc(:, 1).values

# Opdeling af datasættet i træningssættet og testsættet:

from sklearn.model_selection import train_test_split

X_train, X_test, y_train, y_test = train_test_split(X, y, test_size = 1/3, random_state = 0)

Her viser teststørrelse 1/3, at der fra de samlede data er 2/3 del til træning af modellen og resten 1/3 bruges til at teste modellen.

# Lad os tilpasse vores Simple Linear Regression-model til træningssættet

from sklearn.linear_model import LinearRegression

regressor = LinearRegression()

regressor.fit(X_train, y_train)

Lineær regressionsmodel er trænet nu. Denne model vil blive brugt til at forudsige den afhængige variabel.

# Forudsigelse af testsættets resultater

y_pred = regressor.predict(X_test)

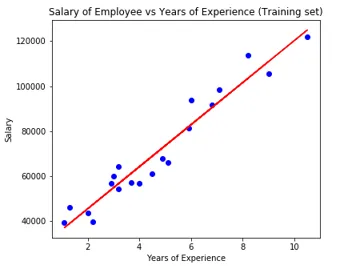

# Visualisering af testsættets resultater

plt.scatter(X_test, y_test, color = 'blue')

plt.plot(X_train, regressor.predict(X_train), color = 'red')

plt.title('Salary of Employee vs Experience (Test set)')

plt.xlabel('Years of Experience')

plt.ylabel('Salary')

plt.show()

# Parameter af model

print(regressor.intercept_)

print(regressor.coef_)

26816.19224403119

(9345.94244312)

Så interceptor (a) -værdien er 26816. Hvilket antyder, at enhver friskere (nul oplevelse) ville få omkring 26816 beløb som løn.

Koefficienten for vores model kom ud som 9345, 94. Det antyder, at ved at holde alle de andre parametre konstante, vil ændringen i en enhed af den uafhængige variabel (år med eksp.) Give en ændring på 9345 enheder i løn.

Regression Evaluation Metrics

Der er dybest set 3 vigtige evalueringsmetriske metoder, der er tilgængelige til regressionsanalyse:

- Middel absolut fejl (MAE): Det viser gennemsnittet af de absolutte fejl, som er forskellen mellem forudsagt og faktisk.

- Gennemsnitlig firkantet fejl (MSE): Den viser middelværdien af firkantede fejl.

- Root Mean Squared Error (RMSE): Det viser kvadratroten af middelværdien af de kvadratiske fejl.

Vi kan sammenligne ovenstående metoder:

- MAE: Det viser den gennemsnitlige fejl og den letteste af alle tre metoder.

- MSE: Denne er mere populær end MAE, fordi den forbedrer de større fejl, hvilket i resultat viser mere indsigt.

- RMSE: Denne er bedre end MSE, fordi vi kan fortolke fejlen i y.

Disse 3 er intet andet end tabsfunktioner.

# Evaluering af model

from sklearn import metrics

print('MAE:', metrics.mean_absolute_error(y_test, y_pred))

print('MSE:', metrics.mean_squared_error(y_test, y_pred))

print('RMSE:', np.sqrt(metrics.mean_squared_error(y_test, y_pred)))

MAE: 3426.4269374307123

MSE: 21026037.329511296

RMSE: 4585.4157204675885

Konklusion

Lineær regressionsanalyse er et kraftfuldt værktøj til maskinlæringsalgoritmer, der bruges til at forudsige kontinuerlige variabler som løn, salg, ydelse osv. Lineær regression overvejer det lineære forhold mellem uafhængige og afhængige variabler. Enkel lineær regression har kun en uafhængig variabel, baseret på hvilken modellen forudsiger målvariablen. Vi har drøftet modellen og anvendelsen af lineær regression med et eksempel på forudsigelig analyse for at forudsige lønningerne for medarbejderne.

Anbefalede artikler

Dette er en guide til Simple Linear Regression. Her diskuterer vi modellen og anvendelsen af lineær regression ved hjælp af et forudsigeligt analyseeksempel til at forudsige medarbejderes løn. Du kan også gennemgå vores andre relaterede artikler for at lære mere-

- Lineær regressionsanalyse

- Lineær regression i R

- Lineær regression modellering

- Værktøjer til regressionstest

- Matplotlib i Python | Top 14 grunde i Matplotlib

- Ordbog i Python | Metoder og eksempler

- Eksempler på Square Root i PHP

- Lineær regression vs logistisk regression | Topforskelle