Oversigt over lineær regression modellering

Når du begynder at lære om maskinlæringsalgoritmer, begynder du at lære om forskellige måder af ML-algoritmer, dvs. overvåget, uovervåget, semi-overvåget og forstærkende læring. I denne artikel beskæftiger vi os med overvåget læring og en af de grundlæggende, men alligevel kraftige algoritmer: Lineær regression.

Derfor er overvåget læring læringen, hvor vi træner maskinen til at forstå forholdet mellem input- og outputværdierne, der er leveret i træningsdatasættet og derefter bruge den samme model til at forudsige outputværdierne for testdatasættet. Så hvis vi har output eller mærkning, der allerede findes i vores træningsdatasæt, og vi er sikre på, at det leverede output giver mening svarende til input, så bruger vi Supervised Learning. Overvåget indlæringsalgoritmer klassificeres i regression og klassificering.

Regressionsalgoritmer bruges, når du bemærker, at output er en kontinuerlig variabel, hvorimod klassificeringsalgoritmer bruges, når output er opdelt i sektioner som Pass / Fail, Good / Average / Bad osv. Vi har forskellige algoritmer til udførelse af regression eller klassificering handlinger med lineær regressionsalgoritme som den grundlæggende algoritme i regression.

Når jeg kommer til denne regression, lad mig indstille basen for dig, inden jeg går ind i algoritmen. I skolegang håber jeg, at du kan huske linjeligningskonceptet. Lad mig give en kort beskrivelse af det. Du fik to punkter på XY-plan, dvs. siger (x1, y1) og (x2, y2), hvor y1 er output fra x1 og y2 er output fra x2, så er linjeligningen, der passerer gennem punkterne (y- y1) = m (x-x1) hvor m er linjens hældning. Efter at du har fundet linjen ligning, hvis du får et punkt siger (x3, y3), ville du let være i stand til at forudsige, om punktet ligger på linjen eller afstanden fra punktet fra linjen. Dette var den grundlæggende regression, som jeg havde gjort i skolegang uden selv at indse, at dette ville have så stor betydning i maskinlæring. Hvad vi generelt gør i dette er, prøv at identificere ligningslinjen eller kurven, der kan passe til input og output af togets datasæt korrekt, og derefter bruge den samme ligning til at forudsige outputværdien af testdatasættet. Dette ville resultere i en kontinuerlig ønsket værdi.

Definition af lineær regression

Lineær regression har faktisk eksisteret i meget lang tid (omkring 200 år). Det er en lineær model, dvs. den antager et lineært forhold mellem inputvariablerne (x) og en enkelt outputvariabel (y). Y her beregnes af den lineære kombination af inputvariablerne.

Vi har to typer lineær regression

Enkel lineær regression

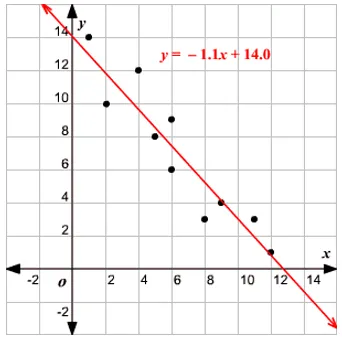

Når der er en enkelt indgangsvariabel, dvs. linje ligning er c

betragtes som y = mx + c, så er det Simple Linear Regression.

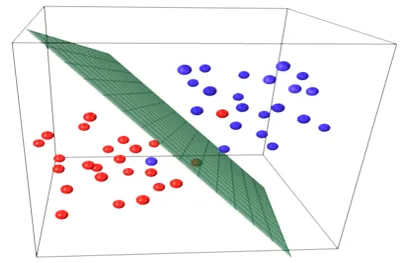

Multipel lineær regression

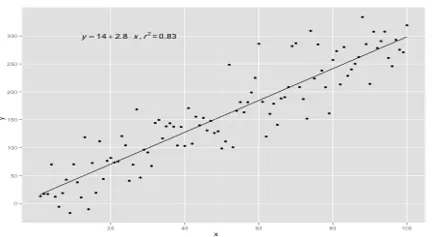

Når der er flere inputvariabler, dvs. linje ligning betragtes som y = aks 1 + bx 2 + … nx n, så er det Multiple Lineær regression. Forskellige teknikker bruges til at forberede eller træne regressionsligningen fra data, og den mest almindelige blandt dem kaldes Ordinary Least Squares. Modellen bygget ved hjælp af den nævnte metode omtales som ordinære mindste kvadrater lineær regression eller bare mindst mindste firkanter regression. Model bruges, når inputværdierne og outputværdien, der skal bestemmes, er numeriske værdier. Når der kun er et input og et output, så er den dannede ligning en linje ligning dvs.

y = B0x+B1

hvor koefficienterne for linjen skal bestemmes ved hjælp af statistiske metoder.

Enkle lineære regressionsmodeller er meget sjældne i ML, fordi vi generelt vil have forskellige inputfaktorer til at bestemme resultatet. Når der er flere indgangsværdier og en outputværdi, er den dannede ligning den for et plan eller et hyperplan.

y = ax 1 +bx 2 +…nx n

Kerneideen i regressionsmodellen er at opnå en linje ligning, der bedst passer til dataene. Den bedste fit line er den, hvor den samlede forudsigelsesfejl for alle datapunkter betragtes som så lille som muligt. Fejlen er afstanden mellem punktet på flyet til regressionslinjen.

Eksempel

Lad os starte med et eksempel på Simple Lineær Regression.

Forholdet mellem en persons højde og vægt er direkte proportional. En undersøgelse er blevet udført på de frivillige for at bestemme personens højde og idealvægt og værdierne er blevet registreret. Dette betragtes som vores træningsdatasæt. Ved hjælp af træningsdataene beregnes en regressionslinjeligning, som giver en minimumsfejl. Denne lineære ligning bruges derefter til at fremsætte forudsigelser om nye data. Det vil sige, hvis vi giver personens højde, skal den tilsvarende vægt forudsiges af den model, der er udviklet af os med en minimums- eller nulfejl.

Y(pred) = b0 + b1*x

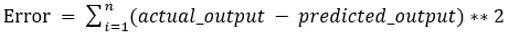

Værdierne b0 og b1 skal vælges, så de minimerer fejlen. Hvis summen af kvadratisk fejl tages som en beregning for at evaluere modellen, er målet at opnå en linje, der bedst reducerer fejlen.

Vi kvadrerer fejlen, så positive og negative værdier ikke annullerer hinanden. For model med en prediktor:

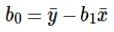

Beregning af aflytning (b0) i linjeligningen foretages af:

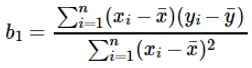

Beregning af koefficienten for inputværdien x foretages af:

Forståelse af koefficienten b 1 :

- Hvis b 1 > 0, er x (input) og y (output) direkte proportionelle. Det er en stigning i x vil stige y, såsom højde stiger, vægt stiger.

- Hvis b 1 <0, er x (prediktor) og y (mål) omvendt proportional. Det vil sige en stigning i x vil falde y, såsom hastigheden på et køretøjsforøgelse, tiden tages formindskes.

Forståelse af koefficienten b 0 :

- B 0 optager restværdien for modellen og sikrer, at forudsigelsen ikke er partisk. Hvis vi ikke har B 0- sigt, tvinges linjeforligningen (y = B 1 x) til at passere gennem oprindelsen, dvs. input- og outputværdierne, der er lagt i modellen, resulterer i 0. Men dette vil aldrig være tilfældet, hvis vi har 0 i input, vil B 0 være gennemsnittet af alle forudsagte værdier, når x = 0. At indstille alle prediktorværdier til 0 i tilfælde af x = 0 vil resultere i datatab og er ofte umuligt.

Bortset fra de ovenfor nævnte koefficienter kan denne model også beregnes ved hjælp af normale ligninger. Jeg vil yderligere diskutere brugen af normale ligninger og designe en enkel / multilinær regressionsmodel i min kommende artikel.

Anbefalede artikler

Dette er en guide til lineær regression modellering. Her diskuterer vi definitionen, typer af lineær regression, der inkluderer enkel og multiple lineær regression sammen med nogle eksempler. Du kan også se på de følgende artikler for at lære mere–

- Lineær regression i R

- Lineær regression i Excel

- Forudsigelig modellering

- Sådan oprettes GLM i R?

- Sammenligning af lineær regression vs logistisk regression